Wie wird der Superbowl in der Zukunft angeschaut? 🤔

Der ganze Superbowl-Hype hat mich an ein Video erinnert:

Die Intel Corporation hat bereits auf der CES 2018 eine Technologie Namens “True View” vorgestellt. Damit ist es möglich, das gesamte Spielfeld mit bis zu 38 Kameras gleichzeitig zu filmen, und dann virtuell eine Kameraposition auszuwählen. Ihr kennt evtl. den “Bullet Time” Effekt aus dem ersten Matrix Film, der technisch so ähnlich funktionierte.

Man braucht dafür keine VR Brille, geht auch am TV oder mobil.

🤔 Warum sollte man das wollen?

Es ist dadurch z.B. möglich, sich direkt auf das Spielfeld neben die Spieler*Innen zu stellen. Es ist aber auch möglich, virtuelle Tribünenplätze gleich mehrfach zu verkaufen.

✅ Zuschauer*Innen können näher dran sein

✅ Veranstalter*Innen können mehr Tickets verkaufen

“True View” ist zwar schon in 20 Football Stadien in den USA und auch in einigen Fussballstadien in Europa installiert, und Intel hatte in L.A. sogar einen eigenen Studio-Dome mit über 100 Kameras gebaut, diesen aber Ende 2020 schon wieder geschlossen.

Die Umsetzung in der Masse scheitert also anscheinend noch am Aufwand und der Datenmenge, immerhin 1 Terabyte für 30sek. Intel hat das Sportgeschäft inzwischen aufgegeben, die Technologie aber an Verizon verkauft!

💡Verizon war auch der Partner von Pepsi Co. bei der “Superbowl Half Time App”, mit der man schon dieses Jahr mitten auf der Bühne von Dr. Dre’s kleiner Hausparty zwischen Snopp Dog, 50 Cent, Eminem, Mary J. Blige und Kendrick Lamar stehen konnte…

Leider war die App in den Deutschland nicht erhältlich, daher hier noch mal der Link zu einem Video-Post von Cathy Hackl

Wenn Ihr mehr über “True View” und Volumetric Capture erfahren möchtet schaut Euch die Keynote von Intel CEO Brian Krzanich auf der CES 2018 auf YouTube an, da wird die Technologie ab 37:04 ausführlich erklärt.

Ich denke, da kommt noch mehr 😉

5. August 2025

Zu Gast im KI-Podcast von HubWerk01

28. March 2025

Interview for “GoSee”

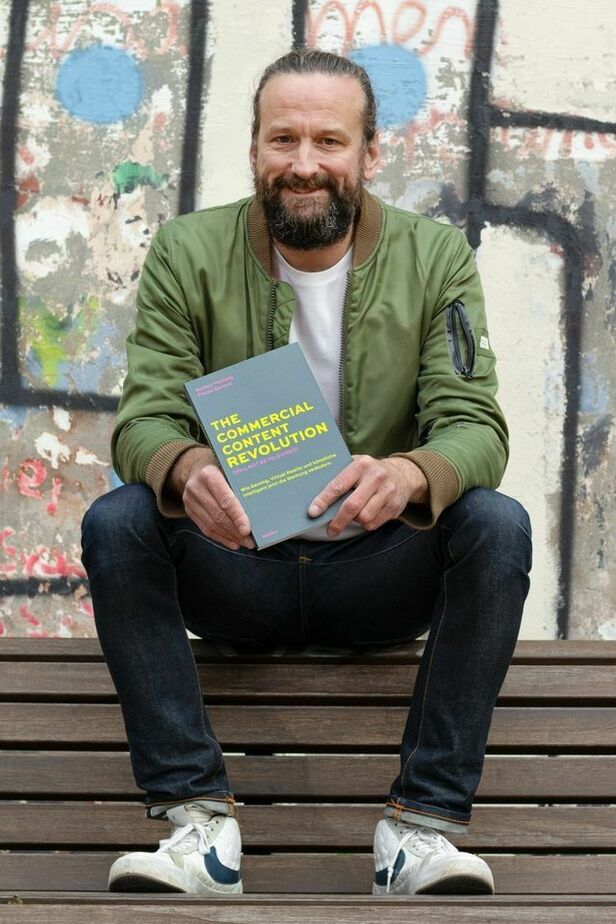

TV Producer & Author Norbert Henning - shaking up the advertising world - on the revolution of brand communication.

As Executive Producer, Team Leader, and Producer on the client side, Norbert Henning has worked on all sides of the advertising film industry over the past 25 years, supporting numerous large and small brands. He closely monitors the changes in the advertising industry. New expectations, particularly from younger audiences, new interactive platforms, technological innovations, and the role of artificial intelligence are creating disruptions that affect everyone. He is surprised that TV is still the leading medium, brands hardly use social media properly, and gaming is still not part of marketing plans. He believes the time has come for a fundamental shift in advertising. In 2024, he published a book to present agencies and companies with approaches on how they can prepare for these changes. In the keynote for his book, he entertainingly and engagingly explains the interconnections and impacts of these developments on the industry and its business models. We present the creative in this interview here at GoSee.

Read full interview here

24. March 2025

Interview for “Internet World Austria”

"Nothing is more short-sighted these days than staying in your silo."

Norbert Henning is the founder of Commercial Content Consulting and a speaker at the JETZT SUMMIT, which takes place in Vienna on March 26 and 27. In this interview, he talks about his afternoon keynote.

Read the interview here.